Última actualización: enero de 2026

Un empleado de finanzas en Hong Kong se unió a lo que parecía ser una videollamada rutinaria con su director financiero y varios colegas para finalizar los detalles de una adquisición confidencial. Después de una discusión aparentemente legítima, el empleado autorizó transferencias electrónicas por $25.6 millones. Cada persona en esa llamada, excepto la víctima, era un deepfake.

Este ataque a la empresa de ingeniería Arup no fue una anomalía. Fue una advertencia. Y para 2026, incidentes como este no serán sorprendentes; se esperará, a menos que las organizaciones reevalúen fundamentalmente cómo se establece la confianza en un mundo donde ver ya no es creer.

En breve

Las pérdidas por fraudes habilitados con deepfake superaron los $200 millones a nivel mundial solo en el primer trimestre de 2025, una cifra que probablemente representa solo una fracción del impacto total debido a la falta de informes.

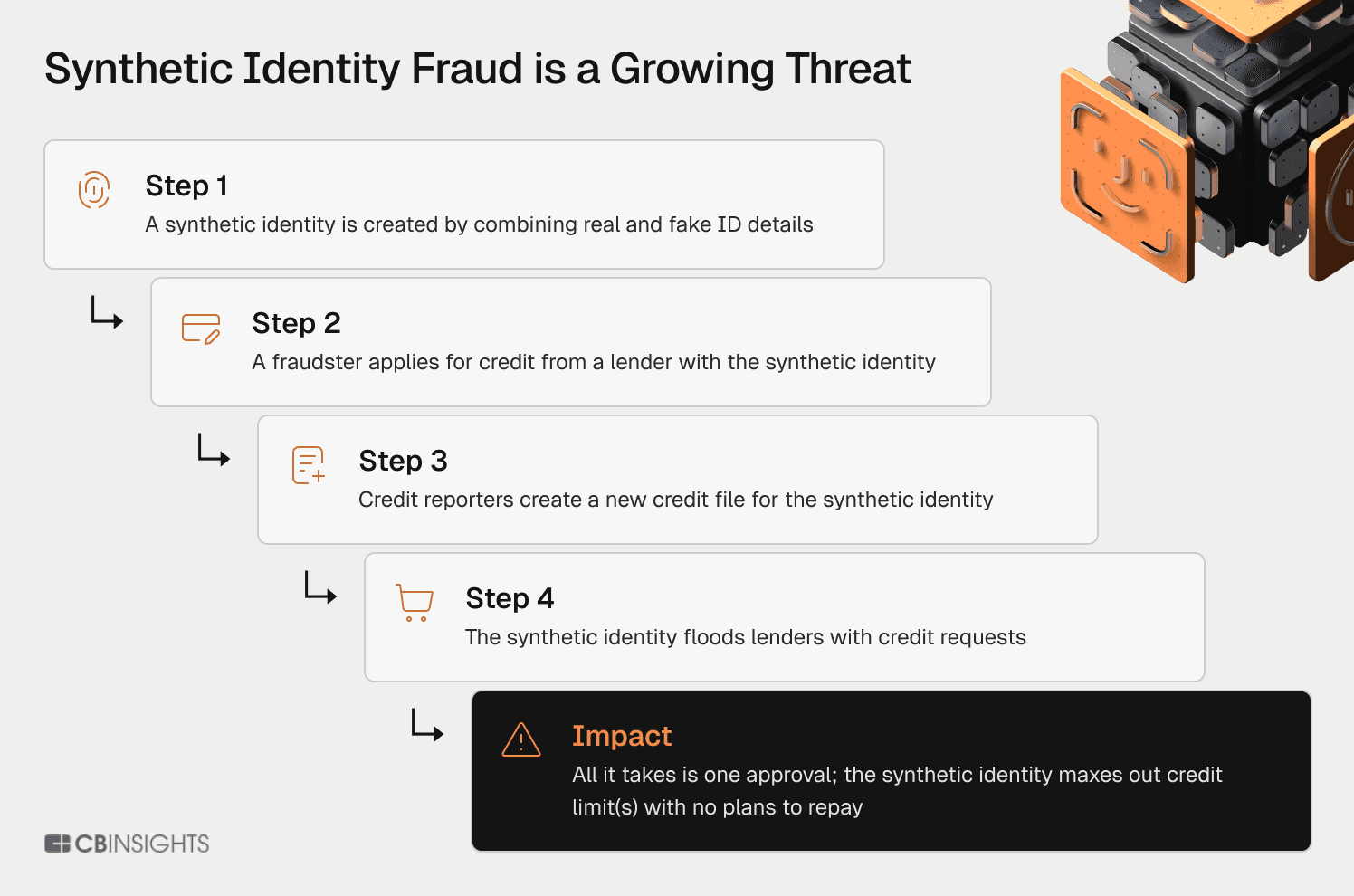

El fraude de identidad sintética ahora representa una pérdida anual de $30–35 mil millones, con la mayoría de las pérdidas ocultas dentro de "pérdidas de crédito" en lugar de ser marcadas como fraude, lo que permite que las identidades fabricadas persistan sin ser detectadas hasta la fecha de incumplimiento.

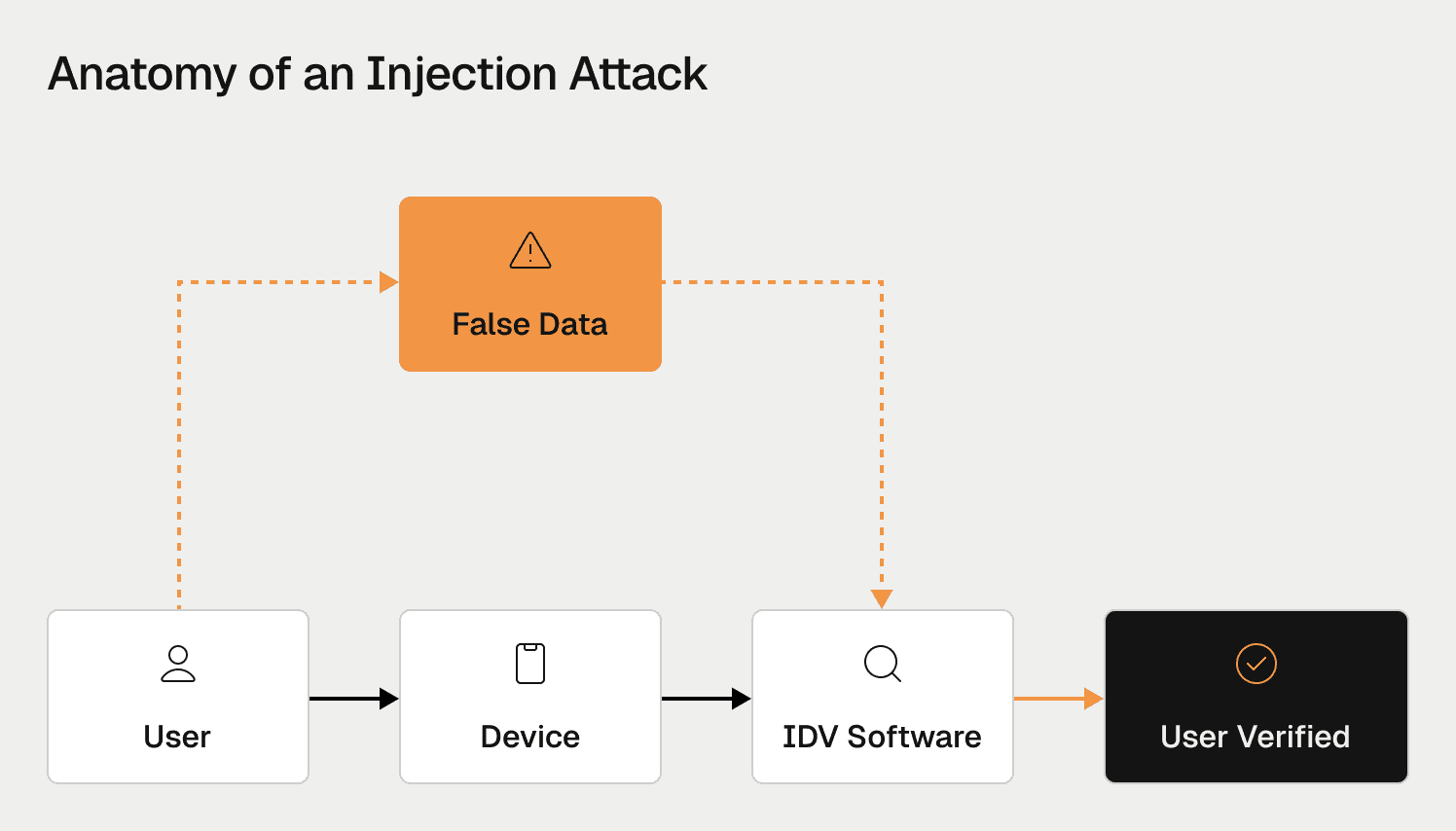

Los atacantes utilizan ataques de inyección para eludir la verificación de video al introducir deepfakes directamente en los flujos de datos, derrotando por completo la detección de los niveles de vida tradicionales.

Se proyecta que el fraude habilitado por IA alcanzará los $40 mil millones anualmente en EE. UU. para 2027 (~30% de CAGR), con Experian llamando a 2026 un punto de inflexión ya que el 72% de los líderes empresariales ahora califican el fraude habilitado por IA como un desafío operativo principal.

La defensa efectiva requiere inteligencia unificada que correlacione señales de identidad, dispositivo, comportamiento y transacciones en tiempo real.

¿Qué tan grande es el problema del fraude con deepfake en 2026?

Las cifras publicadas no capturan la escala real del problema. El fraude habilitado por deepfake rara vez se etiqueta como tal en la contabilidad financiera; en su lugar, las pérdidas se absorben en categorías más amplias como fraude de pagos autorizados, fraude por toma de cuenta o incumplimientos de crédito. Lo que vemos en las cifras oficiales representa solo incidentes verificados y atribuidos, no el impacto real.

Sin embargo, incluso con un recuento sistemáticamente bajo, la aceleración es inconfundible. El Foro Económico Mundial reporta más de $200 millones en pérdidas confirmadas por fraude relacionado con deepfake solo en el primer trimestre de 2025, describiendo la tendencia como un cambio fundamental hacia ataques directos y escalables en las operaciones empresariales.

El Centro de Servicios Financieros de Deloitte proyecta que el fraude habilitado por IA podría llegar a $40 mil millones anualmente en Estados Unidos para 2027, un crecimiento anual compuesto de aproximadamente el 30%. Esa proyección abarca deepfakes, identidades sintéticas, ingeniería social automatizada y toma de control de cuentas impulsada por IA, ilustrando cómo los deepfakes ahora funcionan como un componente en una pila más amplia de fraude impulsado por IA.

Los datos de detección muestran una velocidad similar. Signicat informa que los intentos de fraude con deepfake han aumentado más del 2,000% en los últimos tres años, impulsados por mercados de fraude como servicio y modelos generativos que mejoran rápidamente. El pronóstico de futuro del fraude de Experian para 2026 llama a este año un claro "punto de inflexión", con el 72% de los líderes empresariales identificando el fraude habilitado por IA como un desafío operativo clave.

Las barreras técnicas continúan desmoronándose. Como detallamos en un artículo anterior, la clonación de voz ahora requiere solo de 20 a 30 segundos de audio, mientras que los deepfakes de video convincentes pueden generarse en 45 minutos, haciendo que el fraude de alto impacto sea más barato, rápido y mucho más escalable que los ataques de identidad tradicionales.

¿Qué hace que los ataques de deepfake sean tan efectivos contra los bancos?

La amenaza proviene tanto de los sistemas de entrega como de los propios falsos. Los atacantes modernos eluden la verificación de identidad utilizando ataques de inyección, donde el video sintético se introduce directamente en los flujos de datos a través de software de cámara virtual o emuladores móviles. La aplicación del banco cree que está recibiendo una transmisión de cámara en vivo cuando en realidad está procesando una fabricación digital. Estos ataques derrotan la detección de los niveles de vida por completo, funcionando contra verificaciones pasivas y muchas soluciones activas de niveles de vida (como giros de cabeza o parpadeos) cuando esos desafíos carecen de verdadera aleatoriedad.

Al mismo tiempo, el fraude habilitado por deepfake está escalando debido al auge del fraude como servicio. Grupos organizados ahora venden acceso a herramientas de deepfake listas para usar e infraestructura de fraude de identidad, reduciendo dramáticamente la barrera de entrada para los atacantes. Esto crea un efecto de concentración: herramientas compartidas, activos reutilizados y operadores superpuestos hacen que estas redes sean más visibles para el análisis de redes basadas en gráficos y visuales, permitiendo a los defensores descubrir relaciones y desmantelar anillos de fraude completos en lugar de detener ataques individuales.

Según un análisis reciente de una firma de verificación de identidad, los intentos de fraude crecieron un 21% interanual, y uno de cada veinte intentos de verificación ahora es marcado como fraudulento. Los atacantes combinan cada vez más deepfakes con phishing, ingeniería social y tomas de control de cuentas para abrumar a los controles tradicionales. Por eso, soluciones como la Inteligencia de Identidad Cognitiva de Oscilar van más allá de las verificaciones estáticas, correlacionando comportamiento, infraestructura y señales a nivel de red que las identidades sintéticas, incluso las altamente realistas, no pueden replicar consistentemente.

¿Por qué es el fraude de identidad sintética el "enemigo invisible"?

El Banco de la Reserva Federal de Boston identifica el fraude de identidad sintética como el crimen financiero de más rápido crecimiento en Estados Unidos, con pérdidas que superan los $35 mil millones en 2023. A diferencia del robo de identidad tradicional, el fraude sintético crea identidades "Frankenstein" combinando un número de Seguro Social legítimo (a menudo de un niño, una persona anciana o un individuo fallecido) con nombres y fechas de nacimiento fabricados.

Estas personalidades fabricadas se incuban durante 12-24 meses. Los estafadores solicitan crédito, son rechazados (lo que crea un archivo de crédito), y luego gradualmente construyen historiales de crédito impecables. Para cuando "se escapan" —maximizando las líneas de crédito y desapareciendo— la identidad sintética puede tener un puntaje de crédito de más de 750. Nuestro análisis del uso de AI generativa en la detección de fraudes muestra que los ataques de salida utilizando identidades sintéticas representaron $2.9 mil millones solo en préstamos para automóviles y tarjetas de crédito.

El Kit de Herramientas para la Mitigación del Fraude de Identidad Sintética de la Reserva Federal revela la catástrofe contable: estas pérdidas típicamente se clasifican como "pérdidas de crédito" (mal crédito) en lugar de pérdidas por fraude. Los bancos creen que tienen un problema de suscripción cuando en realidad tienen un problema de fraude, y esta mala clasificación oculta miles de millones a los equipos de riesgo.

Pero las identidades sintéticas solo representan una dimensión de la crisis de identidad. Las instituciones financieras también enfrentan desafíos persistentes de mulas de identidad — personas reales que usan documentos genuinos para establecer cuentas antes de que los estafadores se apoderen de ellas. Estas mulas pueden pasar verificaciones de documentos y selfis, especialmente cuando son reclutadas de países en desarrollo donde el costo de comprometer a un individuo es bajo.

A diferencia de los sintéticos, las mulas dejan rastros de papel limpios hasta el momento de la toma de control, lo que las hace casi invisibles para los controles de incorporación tradicionales.

¿Cómo están los criminales industrializando los ataques de deep fake e identidad sintética?

El ataque a Arup no fue obra de un hacker solitario; fue producto de una cadena de suministro industrializada. La deep web opera como un maduro mercado de "Fraud-as-a-Service". Los servicios de generación de deepfake cuestan tan solo $15 por video. Los "Brokers de Acceso Inicial" venden credenciales para redes comprometidas, mientras que los "Proveedores de Panel" ofrecen botnets por suscripción que hacen que los ataques parezcan originarse desde direcciones residenciales legítimas.

La IA generativa ha acelerado la amenaza. La Reserva Federal advierte que GenAI actúa como "un acelerante" — automatizando la creación de identidades, aprendiendo de los fracasos y optimizando qué perfiles tienen éxito en instituciones específicas. Como se detalla en nuestro análisis de agentes de AI en el fraude y la gestión de riesgos, estos agentes pueden navegar interfaces bancarias, resolver CAPTCHAs y ejecutar miles de micro-transferencias a través de redes de mulas en segundos.

La incómoda verdad: No se puede combatir el fraude industrializado y habilitado por IA solo con personal. Los equipos de revisión manual se ahogarán en el volumen.

¿Por qué siguen fallando las defensas bancarias?

Las instituciones financieras organizan defensas en silos: los equipos de KYC manejan la incorporación, los equipos de fraude monitorean las transacciones, los equipos de AML vigilan el lavado de dinero, y los equipos de crédito gestionan el riesgo de incumplimiento. Los atacantes explotan las costuras. Una identidad sintética pasa el KYC (los documentos parecen legítimos). Crédito aprueba un préstamo (el puntaje es excelente). El equipo de fraude señala un dispositivo sospechoso, pero dado que el usuario está "verificado" y "con crédito aprobado", la alerta se suprime.

Este enfoque en silos crea una paradoja perversa. Los equipos de riesgo y fraude, que ven la actividad fraudulenta como el 100% de su mundo a pesar de que representa el 1-2% del comportamiento real del usuario, a menudo diseñan flujos y características de productos pesados en fricción que frustran a los clientes legítimos. Mientras tanto, ataques genuinamente peligrosos se deslizan porque la información no fluye entre las capas de defensa.

El desafío tiene dos dimensiones: organizativo y temporal. Las instituciones deben distinguir entre la velocidad de detección y la velocidad de acción. Detectar algo sospechoso puede suceder instantáneamente, pero la gravedad del fraude y el valor estratégico de la observación (como usar honeypots para mapear redes de fraude) determina si la acción debe ser en tiempo real o deliberadamente aplazada. Una compra de $50 puede realizarse al instante. ¿Una transacción de reloj de lujo de $50,000? Tanto el comprador como el vendedor esperan la debida diligencia.

Gartner predice que en 2026, el 30% de las empresas ya no confiarán en soluciones de verificación de identidad independientes. El modelo de KYC "de una vez" está fundamentalmente roto. Por eso, el enfoque de AI agente de Oscilar se centra en la inteligencia de riesgo continua en lugar de en la seguridad basada en puntos de control.

Mientras tanto, solo el 22% de las instituciones financieras han implementado herramientas de prevención de fraude basadas en IA, según la plataforma de identidad Signicat, una peligrosa brecha cuando los atacantes operan a velocidad API mientras que los defensores trabajan en procesos por lotes. Casi el 60% de las empresas reportaron un aumento de pérdidas por fraude de 2024 a 2025.

¿Cómo es una defensa efectiva en 2026?

Para 2026, la defensa efectiva depende menos de reglas aisladas y más de inteligencia unificada. Eso significa reunir señales de identidad, dispositivo, comportamiento y transacciones en un único marco de toma de decisiones en tiempo real, de modo que el riesgo pueda evaluarse de manera integral y no fragmentada.

Defenderse contra los deepfakes y el fraude moderno requiere profundidad a través de cuatro capas interconectadas:

Capa 1: Prevención de Registro Masivo

En la capa más externa, los equipos de riesgo trabajan con infoseguridad para detectar relleno de credenciales, creación de cuentas impulsada por bots y credenciales a la venta después de importantes filtraciones de datos. Esto detiene ataques antes de que lleguen a los flujos de verificación legítimos.

Capa 2: Verificación y Validación de Solicitudes

Más allá de validar PII, los controles efectivos en esta capa incluyen la verificación de empleo e ingresos para productos de préstamo. Para préstamos personales, préstamos automotrices e hipotecas, estas verificaciones crean fricción proporcional al riesgo, lo que llamamos fricción prudente, calibrada a la gravedad del evento y la precisión de los modelos de detección.

Capa 3: Monitoreo de Comportamiento Post-Registro

Después de establecer una cuenta, el enfoque cambia a detectar comportamientos sospechosos en el momento de la transacción. Los fraudes de tarjetas de crédito se manifiestan en patrones de primera compra. El fraude en servicios de transporte se manifiesta en anomalías de ubicación, distancia recorrida o comportamiento de conducción. El fraude en el mercado aparece como un crecimiento explosivo de vendedores o tácticas de demora diseñadas para que los compradores piensen que los artículos están en tránsito.

Capa 4: Defensa de Toma de Control de Cuentas

La ingeniería social sigue siendo el vector principal para la toma de control de cuentas. El monitoreo continuo del comportamiento de la sesión, el cambio de dispositivo y los patrones de comunicación pueden detectar cuando un titular legítimo de la cuenta ha sido desplazado por un estafador.

Plataformas como Oscilar están diseñadas para apoyar este enfoque en capas habilitando decisiones en tiempo real a través de fraude, crédito y cumplimiento usando señales compartidas y evaluación de baja latencia, para que los equipos puedan responder rápidamente sin fragmentar sus defensas.

Previniendo deepfakes a través de la superficie de ataque

Aunque los deepfakes pueden parecer convincentes de manera aislada, dejan un rastro de migas en todo el ciclo de vida del dispositivo, la sesión y la aplicación.

Prevenir los deepfakes en la fuente comienza con el análisis del dispositivo y la interacción utilizada para enviar un biométrico. Huellas digitales de dispositivos, detección de emuladores y cámaras virtuales, y señales de comportamiento y cognitivas (como microtemblores en el manejo del teléfono o patrones de duda bajo presión) pueden exponer interacciones sintéticas o coaccionadas antes de que se capture un biométrico.

Prevenir los deepfakes en la captura implica aprovechar el análisis de liveness y biometría potenciados por IA para evaluar si lo que se presenta es realmente humano. Esto va más allá de los desafíos estáticos o deterministas, analizando artefactos biométricos y dinámicas de presentación para detectar inconsistencias sutiles que indican manipulación o síntesis.

Prevenir los deepfakes en la presentación significa tratar la aplicación como una entidad holística, no como un único evento biométrico. Una vez que los datos entran en el sistema, Oscilar correlaciona señales a través de atributos de identidad, documentos, dispositivos, redes y patrones de comportamiento, revelando discrepancias como una coincidencia facial de alta confianza emparejada con un dispositivo anómalo, metadatos de documentos inconsistentes o contexto de transacción sospechoso.

Combatir las identidades sintéticas con datos autorizados

Para las identidades sintéticas, el control fundamental más poderoso sigue siendo el servicio eCBSV de la Administración del Seguro Social, validando si un SSN realmente coincide con los datos de identidad reclamados. Oscilar habilita eCBSV a través de proveedores de identidad confiables como Socure, y enriquece esos resultados con un análisis más amplio del perfil digital: antigüedad del correo electrónico, historial del operador telefónico, reutilización de dispositivos y asociaciones de red, permitiendo a las instituciones financieras distinguir identidades fabricadas de solicitantes legítimos con archivos delgados mientras descubren patrones de fraude repetidos a escala.

Los modelos avanzados de ML han evolucionado más allá de las predicciones de instantáneas en el tiempo. Las capacidades computacionales recientes ahora permiten que las plataformas combinen todos los datos del usuario a lo largo de todo el viaje, proporcionando una imagen holística que resulta mucho más efectiva que los puntos de decisión aislados. Este modelo de inteligencia continua es lo que separa las plataformas de riesgo modernas de los sistemas legados basados en puntos de control.

¿Qué deben hacer los líderes financieros ahora mismo?

El manual operativo para 2026 exige cinco acciones inmediatas:

1. Desmantelar los silos

Si su equipo de fraude no puede ver lo que vio su equipo de KYC, está ciego a los ataques convergentes. Rompa las barreras organizativas entre incorporación, transacciones, crédito y AML.

2. Audite su "bote de pérdidas de crédito"

Identifique cuánto mal crédito es realmente fraude sintético disfrazado. Reclasificar estas pérdidas correctamente desbloqueará presupuesto y urgencia para defensas adecuadas.

3. Asegure el canal de la cámara

Implemente detección de ataques de inyección y trate cada transmisión de video como no confiables hasta que se verifiquen criptográficamente. El biométrico en sí puede ser perfecto, pero si el mecanismo de entrega está comprometido, la verificación no tiene sentido.

4. Desplegar agentes de defensa potenciados por IA

Capacidades de investigación autónoma que escalan con ataques automatizados. Estos agentes pueden decidir si una actividad es buena o mala, solicitar información adicional e identificar casos similares en colas de revisión, permitiendo a los analistas humanos trabajar mucho más rápido.

5. Pasar de la seguridad de portero a la monitorización continua

La confianza debe ganarse nuevamente en cada sesión, en cada transacción. El término emergente de la industria es KYX (Conoce Tu Experiencia), reemplazando el KYC una sola vez con una garantía persistente a lo largo del ciclo de vida del cliente.

La presión reguladora y de estándares está aumentando. Las reglas de 2026 de NACHA exigen "detección de fraude comercialmente razonable" para entradas de débito web. En vigencia para agosto de 2026, el Acta de IA de la UE requiere etiquetado claro de deepfake y controles de transparencia. Los compradores deben evaluar si sus proveedores están abordando de frente los estándares técnicos emergentes, como el CEN/TS 18099, que aborda específicamente los ataques de inyección de datos biométricos.

Como lo demuestran iniciativas como el Protocolo de Agente de Confianza de Visa, el futuro de la confianza depende de la verificación criptográfica de cada actor y cada flujo de datos a través de la cadena de transacciones.

Construyendo nueva infraestructura para la confianza

El robo de $25.6 millones a Arup demostró una nueva y brutal realidad: cuando no se puede confiar en los ojos y oídos, se debe confiar en los datos. La convergencia de identidades sintéticas, inyección de deepfake y automatización agentic ha dejado obsoletas las arquitecturas de seguridad heredadas.

La tecnología para fabricar la realidad existe hoy. La única defensa es un sistema que vea los patrones invisibles detrás de la fabricación —unificado, cognitivo y operando a velocidad de máquina. Plataformas como Oscilar están construyendo esta nueva infraestructura de confianza, combinando la toma de decisiones de riesgo con IA y la inteligencia de identidad cognitiva para detectar fraudes en tiempo real.

Pero el futuro también exige repensar la relación fundamental entre identidad, intención y consecuencia. En una era donde los agentes de IA pueden realizar transacciones en nombre de los usuarios, muchos clientes legítimos priorizarán la privacidad y la conveniencia sobre la divulgación explícita de identidad. El desafío para los gerentes de riesgo no es demandar identificación perfecta en cada punto de contacto, sino calibrar la respuesta de riesgo basada en la gravedad de la consecuencia y la confianza del modelo de detección.

Esto va más allá de la prevención de pérdidas. Lo que está en juego es la fundación de la economía digital: la confianza misma.